openai一早就寻求英伟达投资,但老黄表示:当时太穷了,应该把所有的钱都给他们。

这是黄仁勋在BG2最新访谈中的爆料。

在最新近两小时的深度对谈,老黄不仅曝光了和OpenAI千亿合作的底层逻辑,还抛出了对AI行业的一系列判断:

推理算力需求暴涨近10亿倍,AI正在从记忆回答进化为思考解题;

英伟达1000亿美元投资瞄准的是“AI时代基础设施红利”,OpenAI将成继Meta、谷歌后的下一个万亿级超大规模公司,通过投资变相让OpenAI采购自家芯片是误解;

通用计算时代已经终结,全球超万亿计算基础设施将全面转向加速计算与AI;

“AI产能过剩”是伪命题,在通用计算向加速计算完全转型前,算力缺口只会持续扩大;

……

总的来说,这场对话不仅拆解了AI算力爆发的底层逻辑,还覆盖了当前AI领域企业战略、技术路线、市场趋势等关键方向。

下面来看看这场让网友直呼“最好的英伟达的访谈”具体聊了些什么。

英伟达与OpenAI合作,共建AI时代“算力铁路网”

对话开篇就解析了英伟达与OpenAI在三大核心领域推进的深度协作,其中OpenAI自建AI基础设施是最大亮点。

前两大合作领域聚焦现有云基础设施扩建。一是持续推进微软Azure数据中心建设,双方已经签订了数百亿美元长期合同,后续仍有多年建设周期。

二是联合甲骨文、软银等伙伴搭建OCI(甲骨文云基础设施)的5-7GW算力集群。

第三则是Core Weave的算力支持。

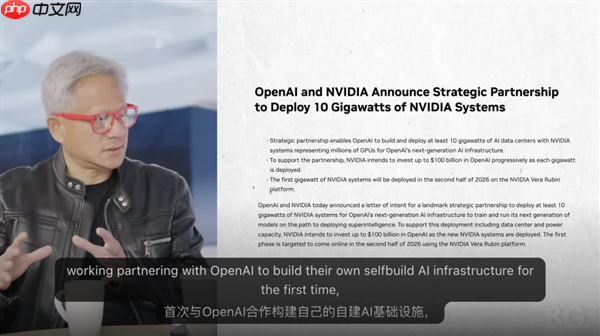

而最关键的新合作,是助力OpenAI首次自建专属AI基础设施。

这就像OpenAI要和我们建立Meta、谷歌级别的直接合作关系。

OpenAI正经历双重指数增长:

一方面用户数量呈指数级扩张,几乎所有应用都在接入其服务;

另一方面,AI从“一键回答”转向“思考推理”,单次交互的算力消耗暴涨。

这两大趋势叠加,让算力需求呈现指数的指数增长,也让双方的合作有了远超常规商业合作的战略意义。

黄仁勋解释,过去OpenAI依赖微软等第三方搭建数据中心,如今自建基础设施后,不仅能满足自身“双重指数级”增长的算力需求,未来还可向其他企业出售冗余算力。

这也正是AWS、Azure等超大规模云厂商的核心商业模式。

至于为何英伟达愿意投入1000亿美元?核心逻辑在于对OpenAI增长潜力的判断。

OpenAI大概率会成为下一个万亿级超大规模公司。

在英伟达看来,此时投资不仅能获得可观的财务回报,更能通过芯片、软件、系统、AI工厂全链路支持,深度绑定AI时代的核心玩家,就像早年通过基础设施合作锁定Meta、谷歌的AI需求一样。

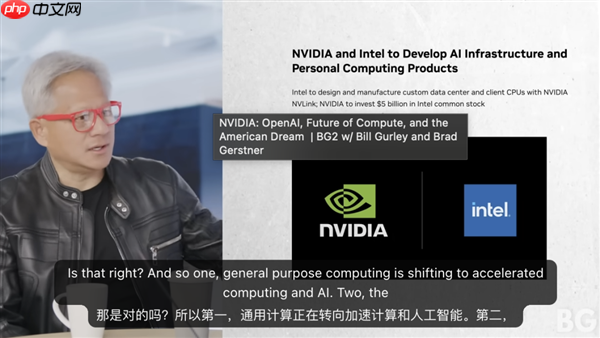

从CPU通用计算到GPU AI计算

通用计算时代已经结束,未来5-10年,全球所有计算基础设施都将转向加速计算与AI计算。

这也是对话中反复强调的核心结论。

黄仁勋用生动的类比阐释这一变革:

就像从煤油灯升级到电力系统,从螺旋桨飞机迭代为喷气式客机。计算方式的革命已经不可逆,且正在加速推进。

目前全球仍有超万亿美元规模的通用计算基础设施(以CPU为核心),这些设施未来都将被以GPU为核心的AI加速计算体系替代,就这个替代过程,就足以支撑算力需求长期增长。

具体来看,两大关键领域的转型已率先启动:

超大规模推荐引擎迭代:过去谷歌、亚马逊等巨头依赖CPU运行系统,现在已经全面转向GPU驱动的AI计算系统,仅这一领域的升级,就涉及数百亿美元市场规模;

数据处理体系重构:目前Snowflake、Databricks等平台的结构化/非结构化数据处理,90%以上依赖CPU,未来将全面转向AI数据处理,这一领域的潜在规模堪比当前AI市场的数倍。

“产能过剩”是伪命题,“循环收入”是误解

针对当前市场对AI算力的两大质疑,老黄对话中也给出了直接的回应。

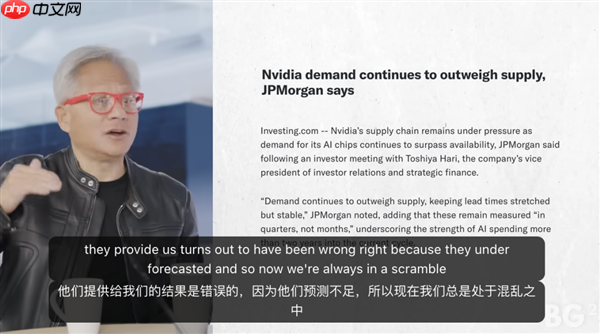

第一个质疑是“2027年算力增长会趋于平缓,AI算力将过剩”。

黄仁勋表示,判断算力是否过剩,要看通用计算向加速计算的转型速度,只要还有企业在处理数据,算力就会持续增长。

他还透露,英伟达作为供应链末端,始终根据客户实际需求信号生产:不盲目扩产,而是根据超大规模厂商、云服务商的年度需求预测调整产能。

但过去两年,几乎所有客户的预测都偏低,英伟达始终处于“按需生产但供不应求”的状态。

第二个质疑是“英伟达投资OpenAI是为了通过投资变相让OpenAI采购自家芯片,间接实现循环收入”。

对此,老黄强调“投资与营收完全独立”。

现在只是投资OpenAI的一个机会。

对于有望成为下一个万亿规模的公司,谁都想成为投资人。

实际上OpenAI一早就想邀请英伟达投资,但老黄表示:当时太穷了,(现在想想)应该把所有的钱都给他们。

主持人询问“如果英伟达的芯片性能不够好、性价比不足,OpenAI完全可以选择其他供应商。”

老黄则表示赞同。

英伟达的定位已经不止于芯片公司

对话中还深入探讨了英伟达的技术迭代。

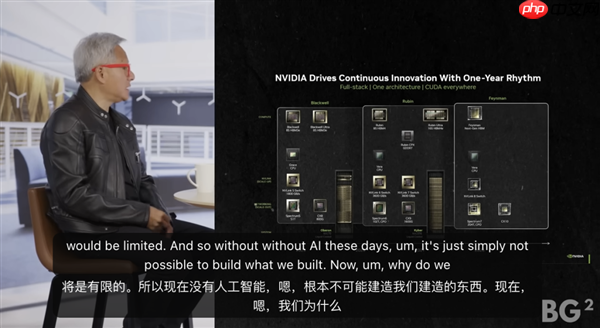

2024年起切换至新的芯片发布周期,从Hopper到Grace Blackwell的重大升级,再到即将到来的Vera Ruben、Ultron、Fineman,每一代产品都实现量级突破。

黄仁勋表示:

没有AI,我们根本无法实现这样的迭代速度。

AI已深度融入芯片设计、软件优化全流程:从芯片架构规划到晶体管布局,从系统软件调试到算力集群优化,AI辅助让研发效率提升数倍。

从长远来看,英伟达的定位已经不止于芯片公司,更着眼于整个AI基础设施。

英伟达想要成为人工智能公司的AI基础设施合作伙伴,寻求多种方式与各方合作。

老黄还幽默地表示:

我们并不要求任何人从我们这里购买所有东西。我们不要求他们购买整架设备,他们可以购买芯片,可以购买组件,可以购买我们的其他产品。可以用我们的GPU搭配其他人的网络。

我唯一的请求就是从我们这儿买点东西。

在这场谈话中,主持人还抛出激进预测:

有人说4.5万亿美元市值的英伟达已经触顶,但英伟达可能是全球首个10万亿美元公司。

毕竟十年前人们说永远不可能有一家万亿美元的公司,但如今已经有了10个。